出典:新志源 画像ソース: Unbounded AIによって生成GPT-5に関するニュースは、最近再びバイラルになっています。OpenAIが密かにGPT-5を訓練していたという暴露の当初から、後のサム・アルトマンによる説明まで。 その後、GPT-5のトレーニングにH100 GPUが何個必要かという話になると、DeepMindのCEOであるSuleyman氏は、GPT-5を秘密裏にトレーニングしていたOpenAIにインタビューしました。そして、新たな憶測が飛び交った。GPT-10は2030年までに出現するというアルトマンの大胆な予測に散りばめられており、これは人類の知能の総和よりも多く、真の汎用人工知能クラウドです。そして、最近のOpenAIのマルチモーダルモデル「Gobi」と、Googleの「Gimini」モデルへの強い呼びかけにより、2つの巨人の競争が始まろうとしています。しばらくの間、大規模言語モデルの最新の進歩は、サークルで最もホットなトピックになっています。古代の詩を「まだ琵琶を持ち、顔を半分覆っている」と言い換えると、非常に適切です。 ただ、いつになったら本当に「久しぶりに出てくる」ことができるのかわかりません。 ## **タイムラインのまとめ** 今日お話しするのは、GPT-5に直接関係するもので、旧友のゲイリー・マーカスによる分析です。核心的なのは、GPT-4から5は、モデルのサイズを拡張するほど単純ではなく、AIパラダイム全体の変化であるということです。 そして、この観点から見ると、GPT-4を開発したOpenAIは、必ずしも最初に5に到達した会社ではありません。言い換えれば、パラダイムを変える必要があるとき、以前の蓄積はあまり転用できません。しかし、マーカスの視点に入る前に、最近伝説的なGPT-5に何が起こったのか、そして世論の分野が何を言っているのかを簡単に振り返ってみましょう。当初、OpenAIの共同創業者であるKarpathy氏は、H100は巨人が求めるホットな話題であり、誰が何台持っているのか、誰もが気にしているとツイートしていました。 その後、各企業がトレーニングする必要があるH100 GPUの数について多くの議論が行われました。 それくらいです。GPT-4は、約10,000〜25,000台のA100で訓練された可能性がありますメタ 約21000 A100テスラ 約7000 A100スタビリティAIはA100で約5000Falcon-40Bは384 A100で訓練されたこれに関して、マスク氏も議論に参加しており、マスク氏によると、GPT-5のトレーニングには30,000〜50,000H100かかる可能性があるとのことです。以前、モルガン・スタンレーも同様の予測を述べていましたが、全体の数はマスク氏が言ったよりも少し少なく、約25,000個のGPUです。もちろん、GPT-5をテーブルに載せて話をするこの波は、サム・アルトマンが噂に反論するために出てきて、OpenAIがGPT-5をトレーニングしていないことを示している必要があります。一部の大胆なネチズンは、OpenAIがそれを否定した理由は、GPT-5ではなく、次世代モデルの名前を変更しただけではないかと推測しました。 いずれにせよ、Sam Altman氏によると、多くの計画が遅れているのはGPUの不足が原因です。 彼は、GPT-4をあまり多くの人に使ってほしくないとさえ言っていました。GPU への渇望は業界全体で同じです。 統計によると、すべてのハイテク大手が必要とするGPUの総数は430,000以上でなければなりません。 これは天文学的な金額で、約150億ドルです。しかし、GPUの量でGPT-5を後退させるのは少し回りすぎたため、DeepMindの創設者であるSuleyman氏はインタビューで、OpenAIが密かにGPT-5をトレーニングしていたことを直接「叩き」ました。もちろん、インタビュー全文の中で、スレイマンは、DeepMindがOpenAIとの競争で遅れをとっている理由など、業界の多くの大きなゴシップについても話しました。また、当時Googleが買収した際にどうなったかなど、内部情報もたくさんありました。 しかし、これらはGPT-5とはほとんど関係がなく、興味のある友人は自分で調べることができます。全体として、この波は業界の大物によるGPT-5の最新の進歩であり、誰もが疑心暗鬼になっています。その後、サム・アルトマンは1対1の接続で、「2030年までに、GPT-10と呼ばれる汎用人工知能が登場すると思います。これは、すべての人間の知能の総和以上のものです」と述べています。 一方では大胆に予測し、他方ではGPT-5をトレーニングしていることを否定しているため、OpenAIが何をしているのかを他の人が本当に知ることは困難です。これに関連して、アルトマンは多くの将来のシナリオを思い描いていました。 例えば、汎用人工知能をどう理解しているのか、汎用人工知能はいつ登場するのか、汎用人工知能が本当に登場したらOpenAIは何をするのか、全人類は何をすべきか、などです。しかし、実際の進捗に関しては、「社内の社員に、私たちの目標は12か月ごとにプロトタイプの性能を10%向上させることだと伝えました」と、アルトマン氏は次のように計画しています。「この目標を20%に設定すると、少し高すぎるかもしれません」 それが具体的な取り決めです。 しかし、10%と20%とGPT-5の関係は明らかではありません。最も価値があるのは、OpenAIのGobiマルチモーダルモデルです。焦点は、GoogleとOpenAIの白熱した競争がどの段階にあるかです。ゴビについて話す前に、GPTビジョンについて話さなければなりません。 この世代のモデルは非常に強力です。 スケッチ写真を撮ってGPTに直接送信すると、Webサイトが数分で作成します。コードを書くことは言うまでもありません。 GPTビジョンが終わった後、OpenAIはより強力なマルチモーダル大規模モデル(コードネームGobi)を立ち上げる可能性があります。GPT-4とは異なり、Gobiはマルチモーダルモデルでゼロから構築されました。これも見物人の興味をそそりました-ゴビは伝説のGPT-5ですか? もちろん、ゴビがどこから来たのかはまだわかりませんし、明確なニュースもありません。スレイマンは、サム・アルトマンが最近、GPT-5を訓練していないと言ったとき、真実を語っていないかもしれないと断固として主張しています。 ## **マーカス・ビュー** まず、テクノロジーの歴史の中で(iPhoneを除いて)GPT-5以上のプレリリース製品が期待されていない可能性は十分にあります。それは、消費者がGPT-5に熱心に取り組んでいるからという理由だけでなく、多くの企業がGPT-5を中心にゼロから始めることを計画しているからでもなく、一部の外交政策でさえGPT-5を中心に構築されています。さらに、GPT-5の出現は、さらにエスカレートしたばかりのチップ戦争を悪化させる可能性もあります。マーカス氏によると、GPT-5の予想スケールモデルを具体的にターゲットにして、生産停止を求める人もいるという。もちろん、非常に楽観的な人も少なくありませんし、GPT-5によって、信頼性の低さ、偏った傾向、権威あるナンセンスな発言をする傾向など、既存のモデルに対する人々の懸念の多くが解消されるか、少なくとも大幅に払拭されるのではないかと想像する人もいます。しかし、Marcus 氏は、単に大規模なモデルを構築するだけで、これらの問題が実際に解決されるかどうかは、彼にとって明らかではなかったと考えています。今日、一部の外国メディアは、OpenAIの別のプロジェクトであるArrakisが、より小さく、より効率的なモデルを作ることを目指しているが、期待された目標を達成しなかったため、トップマネジメントによってキャンセルされたというニュースを伝えました。マーカスは、GPT-4ができるだけ早くGPT-5を発売するだろうとほとんどの人が思っており、GPT-5はGPT-4よりもはるかに強力であると想像されることが多いため、サムがそれを否定してみんなを驚かせたと述べました。これについては、上記のGPUの問題など、多くの憶測が飛び交っており、OpenAIにはこれらのモデルをトレーニングするのに十分な現金がない可能性があります(トレーニングに費用がかかることで有名です)。しかし、繰り返しになりますが、OpenAIは他のスタートアップほど資金が豊富ではありません。 100億ドルを調達したばかりの企業にとって、5億ドルのトレーニングでさえ不可能ではありません。別の言い方をすれば、OpenAIは、モデルのトレーニングや実行にかかるコストが非常に高くなることを認識しており、そのコストで利益を上げることができるかどうか確信が持てないということです。それはある程度理にかなっているようです。3つ目の論拠は、Marcus氏の意見で、OpenAIは5月のAltman氏のプレゼンテーションですでにいくつかの概念実証テストを行っていたが、その結果に満足していなかったというものだ。最終的には、GPT-5がGPT-4の拡大版に過ぎないのであれば、期待に応えられず、あらかじめ設定された目標には遠く及ばないという結論になるかもしれません。結果が期待外れや冗談だけであれば、GPT-5のトレーニングに数億ドルを費やす価値はありません。実際、ルカンも同じことを考えています。GPTは4から5になり、これは単なる4plus以上のものです。 4から5までは画期的になるはずです。ここで必要なのは、単にモデルをスケールアップするだけでなく、新しいパラダイムです。ですから、パラダイムチェンジという観点では、もちろん、会社が豊かであればあるほど、この目標を達成する可能性が高くなります。 しかし、違いは、OpenAIである必要がなくなったことです。 パラダイムチェンジは新しい道なので、過去の経験や蓄積はあまり役に立たないかもしれません。同様に、経済的な観点からも、マーカスが示唆するようにそれが本当なら、GPT-5の開発は無期限に延期されるのと同じです。 新しいテクノロジーがいつ登場するかは誰にもわかりません。現在、新エネルギー車の航続距離は一般的に数百kmであり、数千マイルを走行させたいのであれば、新しいバッテリー技術が必要です。 経験や資本に加えて、新しい技術を突破するには、少しの運とチャンスも必要かもしれません。しかし、いずれにせよ、マーカスが正しければ、GPT-5の商業的価値は将来的に大きく縮小することは間違いありません。リソース:

マーカスがGPT-5をレビュー! 新しいパラダイムが緊急に必要とされていますが、OpenAIには利点がありません

出典:新志源

GPT-5に関するニュースは、最近再びバイラルになっています。

OpenAIが密かにGPT-5を訓練していたという暴露の当初から、後のサム・アルトマンによる説明まで。 その後、GPT-5のトレーニングにH100 GPUが何個必要かという話になると、DeepMindのCEOであるSuleyman氏は、GPT-5を秘密裏にトレーニングしていたOpenAIにインタビューしました。

そして、新たな憶測が飛び交った。

GPT-10は2030年までに出現するというアルトマンの大胆な予測に散りばめられており、これは人類の知能の総和よりも多く、真の汎用人工知能クラウドです。

そして、最近のOpenAIのマルチモーダルモデル「Gobi」と、Googleの「Gimini」モデルへの強い呼びかけにより、2つの巨人の競争が始まろうとしています。

しばらくの間、大規模言語モデルの最新の進歩は、サークルで最もホットなトピックになっています。

古代の詩を「まだ琵琶を持ち、顔を半分覆っている」と言い換えると、非常に適切です。 ただ、いつになったら本当に「久しぶりに出てくる」ことができるのかわかりません。

タイムラインのまとめ

今日お話しするのは、GPT-5に直接関係するもので、旧友のゲイリー・マーカスによる分析です。

核心的なのは、GPT-4から5は、モデルのサイズを拡張するほど単純ではなく、AIパラダイム全体の変化であるということです。 そして、この観点から見ると、GPT-4を開発したOpenAIは、必ずしも最初に5に到達した会社ではありません。

言い換えれば、パラダイムを変える必要があるとき、以前の蓄積はあまり転用できません。

しかし、マーカスの視点に入る前に、最近伝説的なGPT-5に何が起こったのか、そして世論の分野が何を言っているのかを簡単に振り返ってみましょう。

当初、OpenAIの共同創業者であるKarpathy氏は、H100は巨人が求めるホットな話題であり、誰が何台持っているのか、誰もが気にしているとツイートしていました。

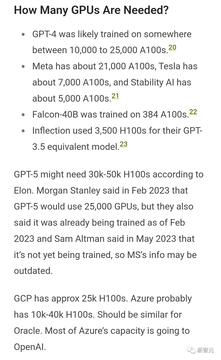

GPT-4は、約10,000〜25,000台のA100で訓練された可能性があります

メタ 約21000 A100

テスラ 約7000 A100

スタビリティAIはA100で約5000

Falcon-40Bは384 A100で訓練された

これに関して、マスク氏も議論に参加しており、マスク氏によると、GPT-5のトレーニングには30,000〜50,000H100かかる可能性があるとのことです。

以前、モルガン・スタンレーも同様の予測を述べていましたが、全体の数はマスク氏が言ったよりも少し少なく、約25,000個のGPUです。

もちろん、GPT-5をテーブルに載せて話をするこの波は、サム・アルトマンが噂に反論するために出てきて、OpenAIがGPT-5をトレーニングしていないことを示している必要があります。

一部の大胆なネチズンは、OpenAIがそれを否定した理由は、GPT-5ではなく、次世代モデルの名前を変更しただけではないかと推測しました。

GPU への渇望は業界全体で同じです。 統計によると、すべてのハイテク大手が必要とするGPUの総数は430,000以上でなければなりません。 これは天文学的な金額で、約150億ドルです。

しかし、GPUの量でGPT-5を後退させるのは少し回りすぎたため、DeepMindの創設者であるSuleyman氏はインタビューで、OpenAIが密かにGPT-5をトレーニングしていたことを直接「叩き」ました。

もちろん、インタビュー全文の中で、スレイマンは、DeepMindがOpenAIとの競争で遅れをとっている理由など、業界の多くの大きなゴシップについても話しました。

また、当時Googleが買収した際にどうなったかなど、内部情報もたくさんありました。 しかし、これらはGPT-5とはほとんど関係がなく、興味のある友人は自分で調べることができます。

全体として、この波は業界の大物によるGPT-5の最新の進歩であり、誰もが疑心暗鬼になっています。

その後、サム・アルトマンは1対1の接続で、「2030年までに、GPT-10と呼ばれる汎用人工知能が登場すると思います。これは、すべての人間の知能の総和以上のものです」と述べています。

これに関連して、アルトマンは多くの将来のシナリオを思い描いていました。 例えば、汎用人工知能をどう理解しているのか、汎用人工知能はいつ登場するのか、汎用人工知能が本当に登場したらOpenAIは何をするのか、全人類は何をすべきか、などです。

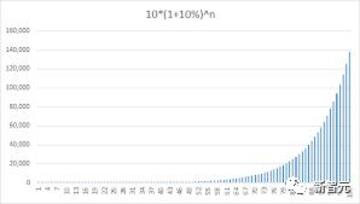

しかし、実際の進捗に関しては、「社内の社員に、私たちの目標は12か月ごとにプロトタイプの性能を10%向上させることだと伝えました」と、アルトマン氏は次のように計画しています。

「この目標を20%に設定すると、少し高すぎるかもしれません」

最も価値があるのは、OpenAIのGobiマルチモーダルモデルです。

焦点は、GoogleとOpenAIの白熱した競争がどの段階にあるかです。

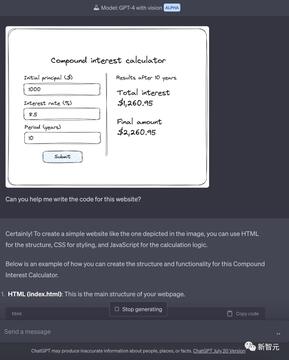

ゴビについて話す前に、GPTビジョンについて話さなければなりません。 この世代のモデルは非常に強力です。 スケッチ写真を撮ってGPTに直接送信すると、Webサイトが数分で作成します。

コードを書くことは言うまでもありません。

GPT-4とは異なり、Gobiはマルチモーダルモデルでゼロから構築されました。

これも見物人の興味をそそりました-ゴビは伝説のGPT-5ですか?

スレイマンは、サム・アルトマンが最近、GPT-5を訓練していないと言ったとき、真実を語っていないかもしれないと断固として主張しています。

マーカス・ビュー

まず、テクノロジーの歴史の中で(iPhoneを除いて)GPT-5以上のプレリリース製品が期待されていない可能性は十分にあります。

それは、消費者がGPT-5に熱心に取り組んでいるからという理由だけでなく、多くの企業がGPT-5を中心にゼロから始めることを計画しているからでもなく、一部の外交政策でさえGPT-5を中心に構築されています。

さらに、GPT-5の出現は、さらにエスカレートしたばかりのチップ戦争を悪化させる可能性もあります。

マーカス氏によると、GPT-5の予想スケールモデルを具体的にターゲットにして、生産停止を求める人もいるという。

もちろん、非常に楽観的な人も少なくありませんし、GPT-5によって、信頼性の低さ、偏った傾向、権威あるナンセンスな発言をする傾向など、既存のモデルに対する人々の懸念の多くが解消されるか、少なくとも大幅に払拭されるのではないかと想像する人もいます。

しかし、Marcus 氏は、単に大規模なモデルを構築するだけで、これらの問題が実際に解決されるかどうかは、彼にとって明らかではなかったと考えています。

今日、一部の外国メディアは、OpenAIの別のプロジェクトであるArrakisが、より小さく、より効率的なモデルを作ることを目指しているが、期待された目標を達成しなかったため、トップマネジメントによってキャンセルされたというニュースを伝えました。

マーカスは、GPT-4ができるだけ早くGPT-5を発売するだろうとほとんどの人が思っており、GPT-5はGPT-4よりもはるかに強力であると想像されることが多いため、サムがそれを否定してみんなを驚かせたと述べました。

これについては、上記のGPUの問題など、多くの憶測が飛び交っており、OpenAIにはこれらのモデルをトレーニングするのに十分な現金がない可能性があります(トレーニングに費用がかかることで有名です)。

しかし、繰り返しになりますが、OpenAIは他のスタートアップほど資金が豊富ではありません。 100億ドルを調達したばかりの企業にとって、5億ドルのトレーニングでさえ不可能ではありません。

別の言い方をすれば、OpenAIは、モデルのトレーニングや実行にかかるコストが非常に高くなることを認識しており、そのコストで利益を上げることができるかどうか確信が持てないということです。

それはある程度理にかなっているようです。

3つ目の論拠は、Marcus氏の意見で、OpenAIは5月のAltman氏のプレゼンテーションですでにいくつかの概念実証テストを行っていたが、その結果に満足していなかったというものだ。

最終的には、GPT-5がGPT-4の拡大版に過ぎないのであれば、期待に応えられず、あらかじめ設定された目標には遠く及ばないという結論になるかもしれません。

結果が期待外れや冗談だけであれば、GPT-5のトレーニングに数億ドルを費やす価値はありません。

実際、ルカンも同じことを考えています。

GPTは4から5になり、これは単なる4plus以上のものです。 4から5までは画期的になるはずです。

ここで必要なのは、単にモデルをスケールアップするだけでなく、新しいパラダイムです。

ですから、パラダイムチェンジという観点では、もちろん、会社が豊かであればあるほど、この目標を達成する可能性が高くなります。 しかし、違いは、OpenAIである必要がなくなったことです。 パラダイムチェンジは新しい道なので、過去の経験や蓄積はあまり役に立たないかもしれません。

同様に、経済的な観点からも、マーカスが示唆するようにそれが本当なら、GPT-5の開発は無期限に延期されるのと同じです。 新しいテクノロジーがいつ登場するかは誰にもわかりません。

現在、新エネルギー車の航続距離は一般的に数百kmであり、数千マイルを走行させたいのであれば、新しいバッテリー技術が必要です。 経験や資本に加えて、新しい技術を突破するには、少しの運とチャンスも必要かもしれません。

しかし、いずれにせよ、マーカスが正しければ、GPT-5の商業的価値は将来的に大きく縮小することは間違いありません。

リソース: